Sistema di segnalazione di abusi

We have renamed the Private Incident Reporting System as Incident Reporting System. The word "Private" has been removed. In the context of harassment and the UCoC the word “Private” refers to respecting community members’ privacy and ensuring their safety. It does not mean that all phases of reporting will be confidential. We have received feedback that this term is therefore confusing and can be difficult to translate in other languages, hence, the change. |

Su questo sistema

La Fondazione desidera migliorare il modo col quale gli utenti che subiscono attacchi o altre condotte problematiche possano riportare questi potenziali abusi, per poter fare della comunità un luogo più sano e sicuro.

Il nuovo Trust and Safety Tools team è stato incaricato di costruire il Sistema privato di segnalazione di abusi (Private Incident Reporting System, PIRS). Il nostro obiettivo è quello di rendere semplice per gli utenti la segnalazione di possibili abusi in modo sicuro e rispettoso della privacy.

Contesto del progetto

La segnalazione e l'elaborazione di possibili abusi è un argomento di interesse per la comunità wikimediana da molti anni. Con la creazione del nuovo Codice di condotta universale, è fondamentale discutere anche dei sistemi di segnalazione degli utenti.

Il modo in cui incidenti, comportamenti scorretti e violazioni delle norme vengono affrontati negli spazi e nei progetti Wikimedia si è sviluppato organicamente e varia a seconda delle comunità.

Ogni progetto o comunità Wikimedia ha il suo modo di gestire le cose. La segnalazione e l'elaborazione di possibili abusi avvengono in diversi modi:

- tramite le pagine di discussione

- tramite le bacheche degli amministratori

- tramite email

- tramite discussioni private su canali di discussione off-wiki (Discord, IRC...)

Per molti utenti non è chiaro cosa fare in caso subiscano un abuso: dove andare, con chi parlare, come fare la segnalazione, quali informazioni includere nella segnalazione, come viene elaborata la segnalazione, cosa succede dopo, ecc.

Gli utenti devono sapere come segnalare un problema e dove farlo. Non esistono poi molte informazioni su cosa accade una volta effettuata la segnalazione e su quali siano le aspettative che l'utente debba avere in proposito.

Alcuni utenti non si sentono sicuri nel segnalare un possibile abuso quando questi si verificano, a causa della complessità del processo di segnalazione e per questioni relative alla tutela della privacy.

Attualmente non esiste un modo standardizzato per gli utenti di inoltrare segnalazioni in forma privata.

Scopo del progetto

L'obiettivo principale di questo progetto è quello di rendere più facile affrontare le molestie e gli abusi.

Vogliamo garantire la privacy e la sicurezza dei segnalanti. Vogliamo inoltre garantire che le segnalazioni contengano le informazioni giuste e raggiungano l'organo appropriato che deve elaborarle, evitando di mettere sotto pressione chi le elabora.

Il Trust and Safety Tools Teamsta anche considerando questo sistema di segnalazione degli abusi come parte di un più ampio ecosistema di gestione degli incidenti, per esempio azioni volte a gestire i disaccordi prima che si intensifichino, elaborare, collegare e monitorare i casi, ecc.

Aggiornamenti al prodotto e tecnici

Test del "Minimum Testable Product" (prototipo) del sistema di notifica di incidenti in versione beta – 10 novembre 2023

I volontari sono invitati a testare il "Minimum Testable Product" (MTP) del sistema di notifica di incidenti

Il team Trust & Safety Product ha creato una versione base di un sistema che permette agli utenti di effettuare una segnalazione dalla talk page nella quale si è verificato uno scontro o un abuso.

Nota: Questa versione del sistema è per apprendere come effettuare una segnalazione tramite un indirizzo email riservato (ad esempio., emergency![]() wikimedia.org o ad un gruppo di amministratori). Questo non copre tutti i possibili scenari come la segnalazione in una pagina pubblica.

wikimedia.org o ad un gruppo di amministratori). Questo non copre tutti i possibili scenari come la segnalazione in una pagina pubblica.

Il feedback degli utenti è necessario per stabilire se questo approccio iniziale è efficace.

Per effettuare il test:

1. Visita una qualsiasi pagina di discussione di Wikipedia in Beta che contenga del testo. Sono disponibili degli esempi di pagine di discussione come User talk:Testing e Talk:African Wild Dog utilizzabili per effettuare il test.

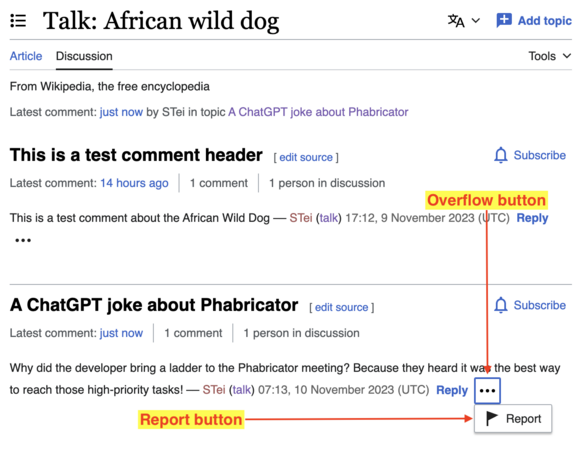

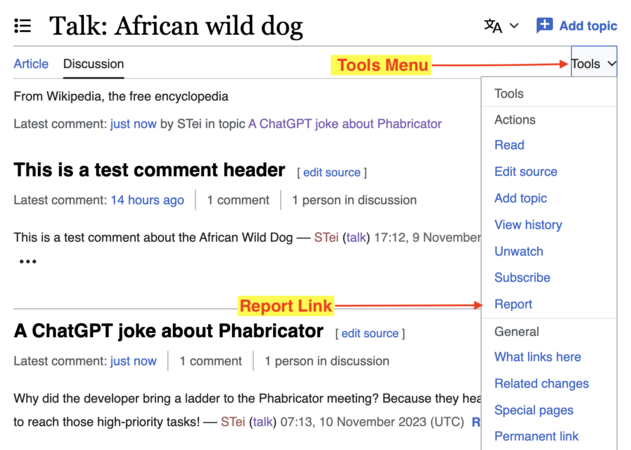

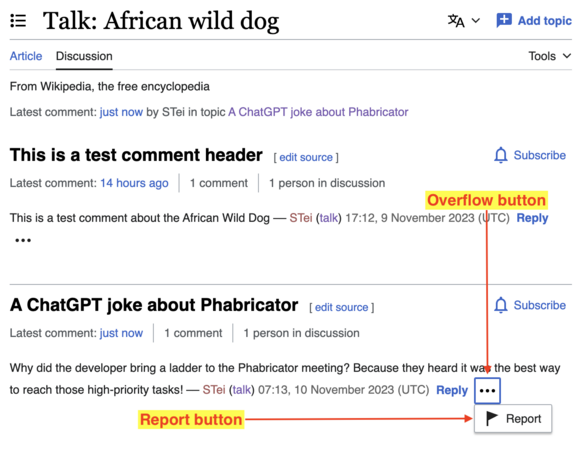

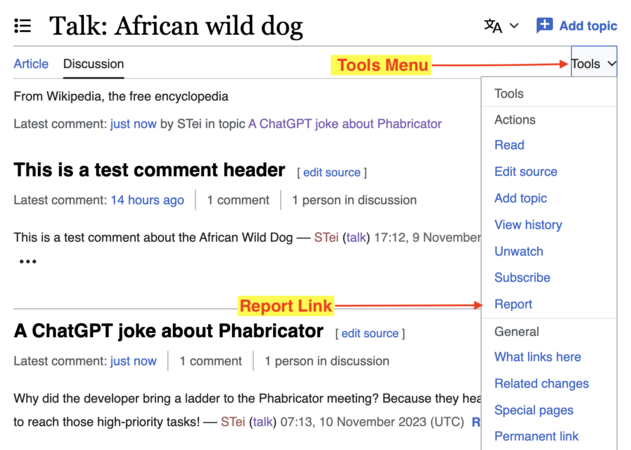

2. Clicca sul tasto di overflow (i tre puntini verticali) a fianco al link Rispondi di ogni commento per aprire il menu di overflow e cliccare Report (vedi slide 1). Puoi anche usare il link Report nel menu Tools (vedi slide 2).

-

Slide 1

Slide 1 -

Slide 2

Slide 2

3. Procedi a effettuare una segnalazione compilando il modulo e inviandolo. Verrà inviata un'email al team Trust and Safety Product, solo loro vedranno la tua segnalazione. Per favore ricorda che questo è un test e non usarlo per segnalare incidenti, scontri e abusi reali.

4. Mentre effettui il test rifletti sulle seguenti domande:

- Cosa pensi di questa procedura di segnalazione? In particolare cosa ti piace e cosa non ti piace?

- Se conosci le estensioni, quale sarebbe la tua opinione se questa fosse una estensione sul tuo wiki?

- Quali punti ci sono sfuggiti in questa fase iniziale di comunicazione?

5. Dopo il test per favore scrivi il tuo feedback nella pagina di discussione.

Risoluzione dei problemi

"Se non riesci a trovare il menu di overflow o i link "Report", o se il modulo non viene inviato", assicurati che:

Se DiscussionTools non si carica, si può effettuare la segnalazione dal menu Tools. Se non è possibile effettuare una seconda segnalazione, per favore nota che c'è un limite di 1 segnalazione al giorno per gli utenti non confermati e di 5 segnalazioni al giorno per gli utenti autoconfermati. Questi requisiti contribuiscono a ridurre la possibilità che gli utenti malintenzionati abusino del sistema. |

Update: Sharing incident reporting research findings – September 20, 2023

The Incident Reporting System project has completed research about harassment on selected pilot wikis.

The research, which started in early 2023, studied the Indonesian and Korean Wikipedias to understand harassment, how harassment is reported and how responders to reports go about their work.

The findings of the studies have been published.

Please see the research section of the page for more.

Four Updates on the Incident Reporting Project – July 27, 2023

Hello everyone! For the past couple of months the Trust and Safety Product team has been working on finalising Phase 1 of the Incident Reporting System project.

The purpose of this phase was to define possible product direction and scope of the project with your feedback. We now have a better understanding of what to do next. Read more.

8 novembre 2022 – Scopo del progetto e prodotto minimo funzionante

Il nostro obiettivo principale negli ultimi due mesi è stato quello di comprendere il problema e le aspettative degli utenti in merito a questo progetto. Il modo in cui vorremmo affrontare la questione è quello di costruire qualcosa di piccolo, un prodotto minimo funzionante (minimum viable product, MVP), che ci aiuterà a capire se l'esperienza di base che stiamo esaminando funziona effettivamente (leggi di più).

Processo

Trattandosi di un progetto complesso, questo deve essere suddiviso in più iterazioni e fasi del progetto. Per ognuna di queste fasi, terremo uno o più cicli di discussione per assicurarci di essere sulla strada giusta e di incorporare tempestivamente il feedback della comunità, prima di lanciarci in grosse porzioni di lavoro.

Fase 1

Ricerca preliminare: raccolta di feedback, lettura della documentazione esistente.

Condurre interviste per comprendere meglio i termini del problema e identificare le domande critiche a cui dobbiamo rispondere.

Definire e discutere la possibile direzione del prodotto e l'ambito del progetto. Identificare le possibili wiki pilota.

Alla fine di questa fase dovremmo avere una solida comprensione di ciò che stiamo cercando di fare.

Fase 2

Creare prototipi per illustrare le idee emerse nella Fase 1.

Creare un elenco di possibili opzioni da consultare e rivedere in modo più approfondito.

Fase 3

Identificare e dare priorità alle migliori idee possibili.

Passaggio allo sviluppo di software e suddivisione del lavoro in ticket di Phabricator.

Continuare il ciclo per le iterazioni successive.

Ricerca

15 July 2024 Update: Sharing Incident Reporting System Minimum Viable Product (MVP) User Testing Summary

In March 2024, the Trust & Safety Product team conducted user testing of the Minimum Viable Product (MVP) of the Incident Reporting System to learn if users know where to go to report an emergency incident, and if the user flow makes sense and feels intuitive.

We learned the following:

- During user testing, all participants found the entry point to report an incident and the current user flow is well understood.

- There was some confusion over two of the reporting options: “someone might cause self-harm” and “public harm threatening message”.

Two participants also made assumptions about the system being automated. One participant was concerned about automation and wanted a human response, whereas the other participant felt assured by the idea it would check if the abuser had any past history of threats and offences, and delete the offensive comment accordingly. All participants expected a timely response (an average of 2-3 days) after submitting a report. Read more.

21 September 2023 Update: Sharing incident reporting research findings

The Incident Reporting System project has completed research about harassment on selected pilot wikis.

The research, which started in early 2023, studied the Indonesian and Korean Wikipedias to understand harassment, how harassment is reported and how responders to reports go about their work.

The findings of the studies have been published.

In summary, we received valuable insights on the improvements needed for both onwiki and offwiki incident reporting. We also learned more about the communities' needs, which can be used as valuable input for the Incident Reporting tool.

We are keen to share these findings with you; the report has more comprehensive information.

Please leave any feedback and questions on the talkpage.

Lavoro svolto in precedenza

Il Trust and Safety Tools team ha studiato le ricerche precedenti e le consultazioni comunitarie per informare il proprio lavoro. Abbiamo rivisto la Proposta di sistema di segnalazione degli utenti per l'iniziativa sulla salute della comunità e la Consultazione sul sistema di segnalazione degli utenti del 2019. Abbiamo anche cercato di mappare alcuni dei flussi di risoluzione dei conflitti tra le wiki per capire come le comunità stiano attualmente gestendo i conflitti. Di seguito è riportata una mappa del flusso di risoluzione dei conflitti della Wikipedia italiana, che contiene note sulle opportunità di automazione.

Domande frequenti (FAQ)

R: Al momento non ci sono molti dati chiari che possiamo utilizzare. Le ragioni sono due. Innanzitutto, gli abusi vengono segnalati in vari modi e differiscono da comunità a comunità. Acquisire questi dati in modo completo e pulito è molto complicato e richiederebbe molto tempo. In secondo luogo, anche l'interpretazione di cosa è un abuso varia. Alcune cose che vengono interpretate come abuso sono in realtà normale amministrazione per una wiki (ad esempio, la cancellazione di una voce promozionale). L'esame delle segnalazioni di abuso può anche richiedere un contesto culturale o comunitario. Non possiamo automatizzare e visualizzare i dati o contarli in modo oggettivo. Il sistema di segnalazione degli abusi è un'opportunità per risolvere alcune di queste esigenze di dati.

D: Come viene definito il concetto di molestia?

R: Per favore, consulta la definizione presente nel Codice di condotta universale.

D: Quanto personale e quanti volontari saranno necessari per supportare il PIRS?

R: Attualmente non si conosce l'entità del problema, quindi non sappiamo quante persone saranno necessarie per supportarlo. La sperimentazione del prodotto minimo funzionante fornirà alcune indicazioni sul numero di persone necessarie per supportare il PIRS.

D: Qual è lo scopo del prodotto minimo funzionante (MVP)?

R: Il prodotto minimo funzionante è un esperimento e un'opportunità per imparare. Questo primo lavoro sperimentale risponderà alle domande che abbiamo in questo momento. I risultati guideranno poi i piani futuri.

D: A quali domande state cercando di rispondere con il prodotto minimo funzionante?

R: Queste sono le domande a cui stiamo cercando risposta:

- Che tipo di segnalazioni verranno inviate dagli utenti?

- Quante persone invieranno una segnalazione?

- Quante persone saranno necessarie per poterle processare?

- Quanto è grande questo problema?

- Possiamo avere un quadro più chiaro dell'entità dei problemi di molestie? Possiamo ottenere dati sul numero di segnalazioni? Le molestie sono sotto-segnalate o sovra-segnalate?

- Attualmente le persone non denunciano le molestie perché non accadono o perché non sanno come farlo?

- Tutto questo sarà difficile da gestire con la nostra attuale configurazione, oppure no?

- Quanti sono i reclami validi rispetto alle persone che non capiscono i processi wiki? Possiamo distinguere/filtrare i reclami validi dalle segnalazioni non valide per risparmiare tempo ai volontari o allo staff?

- Riceveremo per caso molte segnalazioni da parte di persone arrabbiate perché le loro modifiche sono state annullate o la loro pagina è stata cancellata? Cosa ne faremo?

D: Come si pone il movimento Wikimedia rispetto a come altre grandi piattaforme (come Facebook o Reddit) gestiscono le molestie?

R: Anche se non abbiamo davvero molto in comune, il movimento Wikimedia è molto spesso collegato a Facebook e Reddit per quanto riguarda il modo in cui gestiamo le molestie. È importante considerare che nessuno ha risolto il problema delle molestie. Altre piattaforme lottano con la moderazione dei contenuti, e spesso hanno personale pagato che cerca di occuparsene. Due enormi differenze tra noi e Reddit e Facebook sono la natura globalmente collaborativa dei nostri progetti e il modo in cui le comunità lavorano per risolvere le molestie a livello comunitario.

D: WMF sta cercando di cambiare i processi comunitari esistenti?

R: Il nostro piano per il PIRS non prevede di modificare alcun processo comunitario. L'obiettivo è collegarsi ai processi esistenti. Gli obiettivi finali sono:

- Rendere più facile fornire aiuto alle persone che subiscono molestie.

- Eliminare le situazioni in cui le persone non denunciano le molestie perché non sanno come farlo.

- Assicurarsi che le segnalazioni di molestie arrivino agli organismi corretti, che le gestiscono secondo le procedure della comunità locale.

- Assicurarsi che chi se ne occupa riceva segnalazioni fondate e possa reindirizzare i reclami infondati affinché siano gestiti altrove.