Talk:Wikimedia Quarto/3/Draft

Timeline

Actual timeline : it looks like things took forever; but most of the time was spent waiting. I'll try to lay out a similar timeline for WQ/2, when I have time and memory.

Parts of the Quarto were ready for translation the week of April 18; the founder's letter and 4 or 5 early reports. A double-handful of raw content for the retrospective was available; but not gathered into a short page. The translation page was made live with notes not to translate sections which were not labelled as ready for translation; proofreading was at a stand-still.

Most reports were finally ready by the end of May; at this point proofreading stopped altogether. Translators worked on the 2d and 7th pages. The Gallery and Calendar and Retrospective were still unfinished. A second publication push came in June; a design team gathered to beautify the images and layout design, and to work on PDF versions of the content; the gallery was finished. A deadline was set for release of the English edition; the copyediting was finished in a single day. Most images and editing for the whole edition were chosen/inset/finished between Thursday and Sunday at the end of June.

+sj | Translate the Quarto |+ 09:55, 27 Jun 2005 (UTC)

.

Old talk[edit]

Cover[edit]

We need new backgrounds/themes for the coming covers. Suggestions?

- Another featured image, similar to the current cover

- An encyclopedia being edited, similar to sans's work in other langs; like the great Guardian image from last fall

- An olde-tyme encyclopedia cover, completel with old-school text and linotype and line-drawings.

Typos or Adjustments[edit]

Meetup Tokoy,Taiwan... Adjust City or Country? M-Falcon 14:04, 19 Mar 2005 (UTC)

- Those are two different meetups :)

Stories[edit]

How much is left from previous issue which will be in number 3 issue ?

The idea of the little retrospective is nice. We could gather a few old timers to give their version of the past (suggest names). As well as links to saved versions (please past links).

What about asking Gerard to make us a summary on the ultimate wiktionary and stuff around this topic ?

About projects[edit]

Commons[edit]

fr[edit]

Rapport de Jean-Christophe Chazalette (villy)

Lancé le 7 septembre 2004 pour être un conservatoire libre de fichiers multimedia (images, sons, video ...) à destination de l'ensemble des projets de la fondation Wikimedia, Commons s'est développé très rapidement. 76 568 fichiers multimedia étaient disponibles au 16 avril 2005. Le site compte 5 259 utilisateurs enregistrés au 16 avril 2005, dont 53 admins et 2 bureaucrates.

Le multilinguisme est probablement le défi le plus difficile à relever pour Commons. Ce site unique a en effet vocation à servir directement l'ensemble des sites de la fondation, quel que soit leur langage. Par ailleurs, les contributeurs de Commons de toutes origines se rencontrent et doivent pouvoir communiquer sans que la barrière du langage soit un obstacle indépassable. La possibilité d'affecter une ou plusieurs catégories directement à des images et de pouvoir visualiser des vignettes d'image dans les pages de catégorie constitue une première réponse au problème du multilingualisme dans la recherche des fichiers. A l'intérieur du site lui-même, les utilisateurs ont développé un appareil important de modèles linguistiques qui permettent aux pages d'aide principales d'être disponibles dans près d'une dizaine de langues. La création d'un centre de coordination des traductions permet d'ajuster les besoins de traduction des différentes pages d'aide. L'interface de Commons est d'ailleurs disponible dans la plupart des langues. Dernier détail révélateur : si 15 administrateurs sont de langue anglaise, on compte aussi 13 administrateurs en allemand, 6 administrateurs en français, 3 en néerlandais, 3 en polonais, 2 en russe, 2 en suédois, 1 en roumain, japonais, portugais, islandais, hébreu, tchèque, bulgare et biélorusse.

Commons bénéficie par ailleurs de quelques caractéristiques techniques destinées à faciliter l'usage de ses fichiers. Un lien particulier permet d'accéder directement aux derniers fichiers chargés avec un aperçu des images. Les fichiers peuvent être directement utilisés sur les sites de la fondation Wikimedia sans nécessité de les recopier dans les bases locales. L'usage de la balise "gallery", développée pour le logiciel MediaWiki dans sa dernière version, permet une construction rapide de pages de vignettes image.

Quoique Commons soit principalement un site offrant un service aux autres projets de la fondation Wikimedia, les utilisateurs de Commons ont très rapidement mis en place les outils de communication et d'échange que l'on retrouve dans les sites Wikipedia, notamment un bistro et une page de vote dédiée aux suppressions de fichiers. Une liste de diffusion a été créée, ainsi qu'un canal IRC Freenode (#commons.wikimedia). Une vie communautaire spécifique se met donc progressivement en place. Elle s'exprime particulièrement dans le vote pour des images de qualités : des propositions d'images de qualités sont quotidiennement discutées et décidées. Certaines de ces images sont d'une beauté stupéfiante et sont l'oeuvre personnelle de Commoners particulièrement doués. 86 images ont été ainsi choisies comme images de qualité. On peut y voir le signe de la vitalité et de l'originalité d'un projet qui compte à peine sept mois d'existence mais qui s'annonce déjà comme une des plus belles réalisations de la fondation Wikimedia.

en[edit]

Posted by Jean-Christophe Chazalette (villy) (extremely rough translation, copyedit extremely welcome ...)

Launched on September 7, 2004 to be a free repository of multimedia files (images, sounds, videos ...) for all the Wikimedia Foundation projects, the Commons are growing very quickly. On April 16, 2005, 76,568 multimedia files were available. There were 5,259 registered users, including 53 admins and 2 bureaucrats.

Multilingualism is probably the most difficult challenge to be taken up by the Commons. This project is indeed expected to be directly used by the whole Foundation projects, whatever the language. Furthermore, Commons contributors from all origins meet up and have to be able to communicate beyond the barrier of language. The possibility of assigning categories directly to pictures and of viewing thumbnails in category pages is a primary answer to the multilingual searching file issue. Within the site, users have developped an important apparatus of linguistic templates allowing help pages to be available in nearly ten different languages. The creation of a coordination core translation coordination core permits to follow various help pages translation needs. Besides, the Commons interface is available in most languages. Last indicative detail: if 15 administrators are English speakers, we also count 13 German speaking administrators, 6 French speaking, 3 Dutch speaking, 3 Polish speaking, 2 Russian speaking, 2 Swedish speaking, and 1 Romanian, Japanese, Portuguese, Icelandic, Hebrew, Czech, Bulgarian and Belarusian speaking.

The Commons moreover enjoy some technical features meant to facilitate the use of its files. A special link allows direct access to the last uploaded files with thumbnails. Multimedia files can be directly used on the Wikimedia Foundation sites without having to copy them into local databases. The "gallery" tag, developped for the last version of the MediaWiki software, allows to quickly make thumbnails page.

Translation to be continued (...)

Wikinews[edit]

The English Wikinews writing contest has now officially begun. See http://en.wikinews.org/w/index.php?title=Wikinews:Writing_contest for details. This is a contest of endurance; I will try to maintain a daily log of the survivors.

I encourage readers from other Wikinews editions to observe the contest and decide whether it makes sense to implement a local equivalent.

report by Erik, copied here by Anthere

Along with the 1,000 page milestone, another small milestone has been

reached on the English Wikinews: The 10th article containing original

reporting has been published. Since this has been one of a major points

of contention when Wikinews was first proposed, I'd like to give you

all

a brief overview of the progress on this front so far. When we have the

100th article containing original reporting, I'd also like to send out

a

brief press release.

First of all, I think all the original reporting stories we've had so far were responsibly written and reasonably well-researched. Reporters are encouraged by policy to publish their notes (e-mails, transcripts, etc.) for other people to check, as is common within real editorial offices.

The policy governing original reporting is at:

http://en.wikinews.org/wiki/Wikinews:Original_reporting

A list of all such articles can be found at:

http://en.wikinews.org/wiki/Category:Original_reporting

The process for becoming an "official" Wikinews reporter is at:

http://en.wikinews.org/wiki/Wikinews:Credentials

What "original reporting" means in practice varies from case to case. Since there are only 10 such articles so far, it is reasonable to take a look at each of them:

1)http://en.wikinews.org/wiki/Cambridge_Planning_Board_approves_new_science_building_at_Harvard

What the reporter did: took photos of the construction site and the notice of public hearing.

2)http://en.wikinews.org/wiki/Bright_object_falls_from_sky_over_northwest_United_States

What the reporter did: observe the object and describe his observation. (The report has also been confirmed through other sources.) Interesting: The report was first submitted through the http://en.wikinews.org/wiki/Wikinews:Submit_a_story interface.

3)http://en.wikinews.org/wiki/Unrest_in_Belize

What the reporter did: observe the protests, describe his observations, and take photos. (This was a scoop on the western mainstream media.)

4)http://en.wikinews.org/wiki/Report_urges_Kenya_to_ban_plastic_bags

What the reporter did: contact the US Film and Bag Federation and ask them for a comment on a proposed tax on paper and plastic bags.

5)http://en.wikinews.org/wiki/New_York_Public_Library_opens_collection_of_275%2C000_digital_images

What the reporter did: contact the NYPL and Larry Lessig regarding the question whether public domain art can be encumbered with license or usage fees.

6)http://en.wikinews.org/wiki/Iraqi_elections_kept_low-key%2C_but_secure%2C_in_Paris

What the reporter did: observe the voting process and take photos of the polling stations.

7)http://en.wikinews.org/wiki/GAA:_Westmeath_beat_Donegal_by_narrowest_of_margins

What the reporter did: watch a football game and write a report.

8)http://en.wikinews.org/wiki/First_Swahili_office_suite_released_in_Dar_es_Salaam%2C_Tanzania

What the reporter did: conduct an extensive interview with project leader Alberto Escudero-Pascual. / /9)http://en.wikinews.org/wiki/Conference_discusses_the_credibility_of_blogs

What the reporter did: provide coverage directly from the conference and send it to other Wikinewsies via IRC who then summarized it in the article.

10)http://en.wikinews.org/wiki/Atlas_V_rocket_launches_with_Inmarsat_satellite

What the reporter did: watch a webcast of the launch and describe it.

So in this small selection, we already have everything from eyewitness reports to collaborative efforts to email inquiries to webcasts. I think this is a good sign. Of course, our reporting is necessarily completely unevenly spread about different topics at this point, but hopefully, it will normalize over time.

On a related note, the German Wikinews has also published a significant number of stories containing original reporting, mostly on very local topics. These aren't categorized as on the English WN, but they can be found through:

http://de.wikinews.org/w/index.php?title=Spezial:Whatlinkshere&target=Wikinews%3AAkkreditierung

I would be interested in hearing about the state of original reporting on other Wikinews editions.

report by Erik, copied here by Anthere

Un comité d'arbitrage pour fr:Wikipédia[edit]

Rapport de Jean-Christophe Chazalette (villy)

Un comité d'arbitrage a été élu le 22 mars 2005. Cette élection constitue la dernière étape d'un processus lancé le 19 septembre 2004 pour discuter et voter, d'une part, le principe même de la création d'un tel comité et, d'autre part, les règles gouvernant la procédure d'arbitrage, les pouvoirs du comité d'arbitrage et le mode de désignation des arbitres.

Cette initiative tire les leçons des difficultés rencontrées par la communauté francophone pour gérer les conflits entre éditeurs par vote public de sanctions. Les tensions qui se sont manifestées dans le courant des deuxième et troisième trimestres 2004 ont montré les limites du vote communautaire : la période de vote donne lieu à des polémiques, à des pages de vote en réplique et plus généralement, à l'installation d'un climat désagréable, avec une baisse de l'émulation générale ; les votants hésitent à s'engager dans un sens ou dans l'autre, et le font parfois pour des raisons étrangères aux faits reprochés, par solidarité de principe avec tel ou tel ; enfin, le vote ne s'appuie pas toujours sur une lecture exhaustive et raisonnable des historiques de page, d'ailleurs difficiles à trouver, mais plutôt sur le ressenti subjectif d'un comportement critiqué.

Trois consultations successives ont été nécessaires pour parvenir à l'adoption de l'ensemble des règles permettant la mise en oeuvre des arbitrages. Il a notamment été décidé que le comité d'arbitrage ne pouvait se saisir d'office mais qu'il pouvait décliner une demande. Une autre règle importante prévoit que « les arbitres tranchent des litiges individuels sans édicter de règles de comportement applicables sur le site, cette démarche relevant de la communauté du site. Si les arbitres se réfèrent aux motifs ou à la solution d'une décision arbitrale passée, ils doivent expliquer en quoi l'affaire qui leur est soumise est similaire ou comparable. » A ce jour, la seule question encore en suspens est celle du recours contre les décisions du comité d'arbitrage. Les arbitres sont au nombre de 7, élus pour un mandat de 6 mois renouvelable. Le premier comité d'arbitrage se compose d’Aoineko, Arnaudus, Greudin, (:Julien:), Romary, Semnoz et Spedona.

L'instauration d'un tel comité, qui est parfois vécu comme le signe d'une bureaucratisation exagérée de la communauté, devrait néanmoins permettre à celle-ci de gérer de manière équitable et apaisée des situations de conflit qui ont vocation à se multiplier avec l'augmentation constante du nombre des contributeurs.

PlanetMath Collaboration[edit]

posted by +sj+ Here's a small blurb about a collaboration on Wikipedia with another non-Wikimedia GFDL project, for the next Quarto.

In January 2005 the PlanetMath Exchange project was started to assist in content exchange between Wikipedia and PlanetMath, a community-based math encyclopedia under the terms of the GFDL that started in 2001. The project aims to enrich the content of math articles on Wikipedia. Although there are only eight participants now, nearly 500 articles from PlanetMath have been examined, and about 40% have had content merged into Wikipedia.

Short URL for the project: http://en.wikipedia.org/wiki/WP:PMEX

Statistics for the project are here -- so update numbers in the blurb as necessary.

Also, if it's relevant to mention people, I (Derek Williams, en:User:CryptoDerk) started it, and Oleg Alexandrov (en:User:Oleg Alexandrov) has done scripting to auto generate and update the lists we work from.

Wikiquote[edit]

posted by Aphaia ... many flaws on foundation-l version were corrected ...

Wikiquote project is a multilingual online open-content compendium of quotations. On March 25, 2005 it was revealed the project had reached 10,000 articles in total, thanks of q:User:Pumpie, an editor on English Wikiquote. It took 21 months since its inception in July 2003. Unfortunately, it is uncertain what is the 10,000th article exactly.

As for March 31, among over 70 Wikiquote projects, 22 languages are very active. About 4,000 user accounts have been created in total and there are many unregistered editors too as same as other projects. Currently four Wikiquote projects, English, German, French and Polish have more than 1,000 articles. The largest one is English with almost 2,700 articles. Among top ten Wikiquotes, eight are in European languages, two are in Asian languages - Chinese and Japanese. In non-latin-alphabet projects Burgarian language project is the largest with over 500 articles.

Most of Wikiquotes focus on authors who wrote in their own language but there are many good translation. Some Wikiquotes, including Japanese and English ones, show a strong inclination to the original text, and many quotes are accompanied with original texts. This tendency is easily found on proverb articles.

Technical reports[edit]

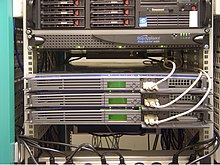

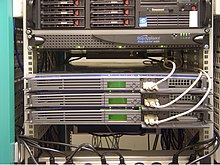

Caches installed near Paris[edit]

- Report from David Monniaux.

In December 2004, servers donated to the Wikimedia Foundation were installed at the Telecity facility located in Aubervilliers on the outskirts of Paris, France. The network access is donated by French provider Lost Oasis. In January, the software setup was completed; however, various problems then had to be ironed out.

As of April 1, 2005, those machines cache content in English and French, as well as all multimedia content (images, sounds...), for users located in Belgium, France, Germany, Luxembourg, Switerland, and the United Kingdom (daily stats per country). The caches work as follows: if they hold the requested page in their local memory, they serve it directly; otherwise, they forward the request to the main Florida servers, and memorizes the answer while passing it to the browser of the Wikipedia user. Typically, for text content, 80% of accesses are cached (that is, they are served directly); the proportion climbs to 90-95% for image accesses. Due to the current way that the Mediawiki software works, content is cached much more efficiently for anonymous users: essentially, all text pages have to be requested from Florida for logged-in users.

The interest of such caches is twofold:

- First, they relieve the load on the main Wikimedia Florida servers. We have to buy our bandwidth (network capacity) for Florida, whereas we can get (smaller) bandwidth chunks in other locations.

- Second, they make browsing much quicker and responsive, at least for anonymous users. Any access to the Florida servers from Europe may take 100-150 ms round trip; this means that retrieving a complete page may take a significant fraction of a second, even if the servers respond instantaneously. The Paris servers, on the other hand, have much smaller rountrip times from the countries they serve.

The Paris caches serve as a production experiment and test bed for future cache developments, which are currently being studied. We may, for instance, change the caching software in order to reduce the load on the caches (currently, with all the countries they serve, the machines are loaded 80-95%; the machines are, however, quite outdated), and see how we may improve efficiency and cache rates (it appears that the caches do not perform as efficiently as they should by fetching data from each other).

Caches installés près de Paris[edit]

- Rapport de David Monniaux.

En décembre 2004, des serveurs (micro-ordinateurs type PC à base de Céléron, format enchâssable) gracieusement offerts à la Fondation Wikimédia ont été installés dans le centre Telecity d'Aubervilliers tout près de Paris, France. L'accès réseau est gracieusement fourni par le prestataire français Lost Oasis. En Janvier, l'installation logicielle a été terminée ; cependant, divers problèmes n'étaient pas encore réglés.

Au premier avril 2005, ces machines rangent en mémoire cache les pages de textes en anglais et en français, ainsi que les contenus multimédia (images, sons...) pour les utilisateurs de Belgique, de France, d'Allemagne, du Luxembourg, de Suisse, et du Royaume-Uni (statistiques ventilées par pays). Les serveurs « cache » fonctionnent de la manière suivante : si la page demandée est en mémoire, ils la servent directement ; sinon, la requête est renvoyée aux serveurs floridiens, et la réponse est mémorisée avant d'être renvoyée au navigateur de l'utilisateur. Typiquement, pour du contenu texte, 80 % des accès se font en cache ; la proportion monte à 90-95 % pour les images. En raison du fonctionnement actuel du logiciel MediaWiki, le contenu texte est caché bien plus efficacement pour les utilisateurs anonymes; pour les utilisateurs nommés, toutes les pages de texte ou presque doivent être générées à la demande par les serveurs floridiens.

Ces caches ont deux grands intérêts :

- Premièrement, ils diminuent la charge des serveurs principaux, situés en Floride, dont nous payons la bande passante (capacité de transfert réseau), alors que nous pouvons obtenir des dons de plus petites fractions de bande passante ailleurs dans le monde.

- Deuxièmement, ils rendent la navigation bien plus rapide et agréable, au moins pour les utilisateur anonymes. Tout accès aux serveurs floridiens depuis l'Europe peut demander entre 100 et 150 ms aller-retour, ce qui implique que la récupération d'une page complète puisse prendre une fraction importante d'une seconde, même si les serveurs répondent instantanément. Ce délai est en grande partie dû à des impossibilités physiques, et ne pourra pas être diminué de façon importante même avec les améliorations du réseau. Les serveurs parisiens, en revanche, ont des temps de latence réseau bien plus faibles pour les pays auxquels ils fournissent des pages.

Les caches parisiens sont une expérimentation en situation réelle et un banc d'essai pour de futurs déploiements de caches, actuellement à l'étude. Nous pourrons prochainement, par exemple, essayer des ajustements dans le logiciel de cache (logiciel Squid) afin de diminuer la charge des machines (actuellement, avec tous les pays qu'ils desservent, les serveurs parisiens sont chargés à 80-95 % ; il faut toutefois noter qu'il s'agit de matériel un peu ancien), et nous pourrons essayer des réglages augmentant l'efficacité des caches (ainsi, il semble que les caches ne récupèrent pas les données l'un vers l'autre autant qu'ils le devraient).

Proxy scanning[edit]

Since March 28th 2005, Wikipedia has started automatically blocking edits comming from open proxies. A short description of this feature can be found at Proxy blocking.